審査委員

● 古川 聖(先端芸術表現科教授)、○ 伊藤 俊治(先端芸術表現科教授)、◎八谷 和彦(先端芸術表現科准教授)、三輪 眞弘(情報科学芸術大学院大学教授)、

1981年 札幌生まれ

2008年 京都大学理学部卒業(数学系)

2010年 東京大学大学院情報理工学系研究科システム情報学専攻修士課程修了

2012年- 日本学術振興会特別研究

主な論文

Tsubasa Tanaka, Takuya Nishimoto, Nobutaka Ono and Shigeki Sagayama,“Automatic Music Composition Based on Counterpoint and Imitation Using Stochastic Models,” Proceedings of 7th Sound and Music Computing Conference, pp.330-337, 2010.

Tsubasa Tanaka and Kiyoshi Furukawa,“Automatic Melodic Grammar Generation for Polyphonic Music Using a Classifier System,” Proceedings of 9th Sound and Music Computing Conference, pp.150-156, 2012.

田中翼, 古川聖, 「多声音楽の旋律スタイルの文法的なモデル化および自動生成」, 情報処理学会論文誌, 54巻4号, pp.1308-1318, 2013.

田中翼, 古川聖, 「群の生成系としての音程スケール」, 先端芸術音楽創作学会 会報, Vol.5 No.1, pp.3-9, 2013.

Tsubasa Tanaka, Hidefumi Ohmura and Kiyoshi Furukawa,“Reinforcement Learning Models for Acquiring Emotional Musical Modes,” Proceedings of 10th Sound and Music Computing, pp.40-47, 2013.

主な個展

2009年 「情報技術時代のピアノ音楽」東京ワンダーサイト本郷

2010年 「変奏曲展Ⅲ-シュレーディンガーの猫の鳴き方」東京ワンダーサイト本郷

2012年 「Reminiscing Machine」東京芸術大学情報芸術センター

20世紀以来、情報技術は芸術の領域に大きな変化を及ぼしてきた。特に音楽は数として取り扱いやすいこともあり、芸術の中でも科学技術との親和性が高く、電子音楽の作曲、音響合成、自動作曲、音楽生成支援技術、音楽情報検索などの研究が行われてきた。現在では、音楽プログラミング言語Max(Max/MSP)や歌声を生成するボーカロイドなどをはじめ、音楽生成の支援技術は実用化し、様々なソフトウェアを誰もが手軽に使用できる状況にある。また自動作曲の工学研究においては、様々なジャンルの楽曲をコンピュータが摸倣して生成するような研究が行われてきた。しかしこのような、人間の創作をコンピュータが支援したり、人間の考え出した音楽スタイルをコンピュータが摸倣するという人間中心の方向性とは異なり、私はコンピュータがいかにオリジナルかつ的確な音楽スタイルを計算によって生成しうるのかを問題として研究を行ってきた。そこで私がとったアプローチは、個々の作品を深層から規定する音楽理論的な構造を対象とした数理的生成手法を開発し、それによって新しい音楽スタイルを創出するというものである。生成対象としては次の四つの音楽理論の領域を扱ってきた。

第一の生成対象は、音楽理論の最も中核的な部分の一つである旋法(ここでの旋法の定義には、単純なピッチの集合としての音階に加えて、旋律的な音程のとる傾向をも含める)である。本研究では旋法が感情表現と密接な結びつきを持つことに着目し、楽しさ、悲しさなどのターゲットとする感情を良く表現できるような旋法の獲得を目的とした。そして、人間からの評価値のフィードバックを利用して、旋法を感情に適応させていく方法論を提案した。この手法の利点は、適応的な手法を用いることで、通常の心理実験のように予め固定した無数の旋法を逐一評価する必要がなくなり、あらゆる種類の旋法の中から未知の旋法を発見できる可能性がある点である。

第二の生成対象は、旋法をより具体的な旋律に結びつけるための旋律法である。新たな旋律法を生成しようとする際には、既存の旋律から学習するような従来の手法をとることは困難である。そこで本研究では、出来上がった旋律よりもむしろ、人間の作曲者が旋律スタイルを創造するプロセスを摸倣することで、オリジナルな旋律を生成するためのモデル化を行った。そこでは、作曲家メシアンの、音型の引用と合成による作曲プロセスを参照し、それを形式文法ルールとして捉え直した。そして進化や淘汰を模擬した遺伝アルゴリズムによりルールの探索を行い、互いに整合的な文法規則の創発を試みた。また、多声音楽にも対応するため、声部ごとに異なる(または同じ)旋律法が同時共存するモデル化を行った。評価実験の結果、ルール数を小さく抑えた場合に、旋律スタイルの独創性や統一性などのスタイルの評価が向上することなどが明らかになった。

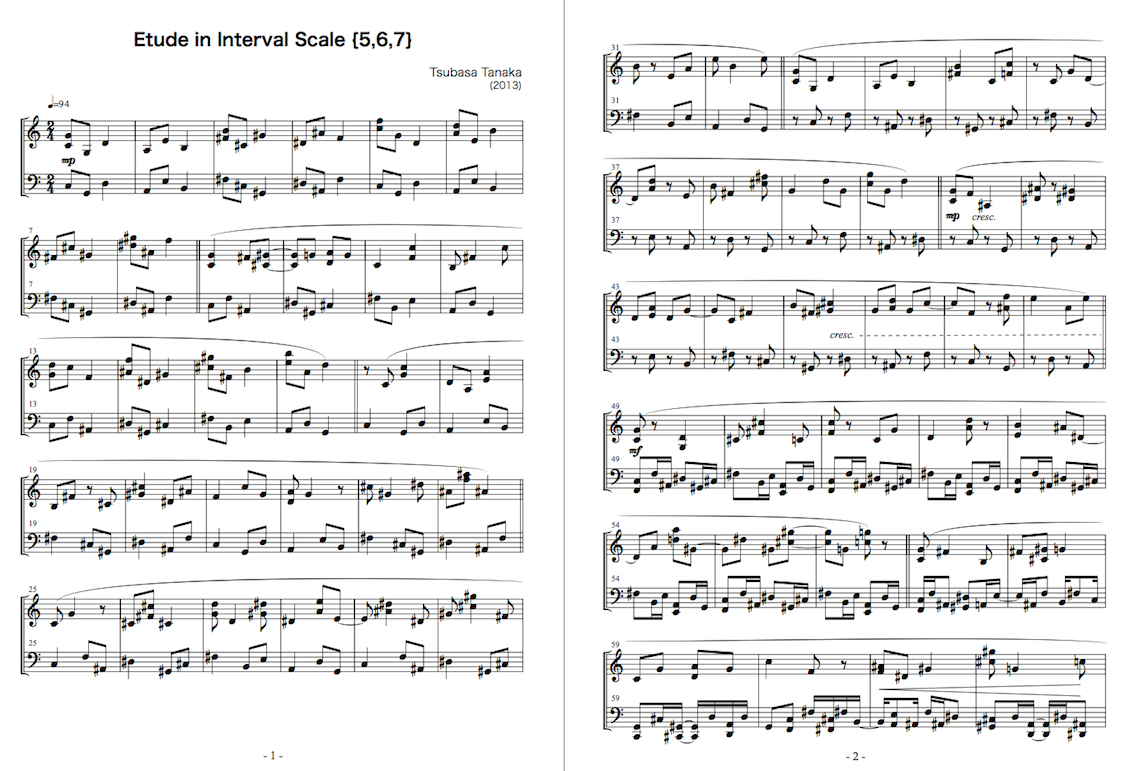

第三の生成対象は、とりうる音程の集合を限定する概念として私自身が定義した「音程スケール(interval scale)」である。これは、旋法に基づかない無調音楽においても、旋法や調による色彩の差異のようなものを表現できるようにするための概念であり、旋法から音程の情報のみを抽出した、旋法の概念の変化形である。本研究では、どのような音程スケールを選択すると、そこからどのような種類のピッチが生成されうるのかという数学的法則性を探求し、三つの定理を見いだした。これらの定理によって、ある種の望ましい音程スケールを得るための手順が明確化する。図の作品「Etude in Interval Scale {5,6,7}」における{5,6,7}という音程の集合(音程スケール)はそうして見いだされたものである。

ピアノ曲《Etude in Interval Scale {5,6,7}》

第四の生成対象は、サウンドファイルの対位法である。これは従来の対位法と異なり、音符ではなくサウンドファイルの断片を単位素材とする対位法(同時的/経時的に互いに調和するサウンドファイル断片の組み合わせ)として私が名づけた概念である。近年はビッグデータの時代と呼ばれるように、音楽においても、蓄積された多量のサウンドファイルの内容を検出する音楽情報検索の研究が行われている。サウンドファイルの対位法を考えることは、そうした自動処理技術を電子音楽の作曲法のレベルに組み込むという今日的な課題である。本研究では、多数のサウンドファイル群のピッチやアタックなどの情報を解析し、同時的/経時的に調和するサウンドファイル間の組み合わせを自動的に発見し、コラージュする音楽生成システムを構築した。ここでは、生成した旋法や音程スケールを、サウンドファイル間の調和の基準として用いることもできる。本展覧会では、この音響システムを展示する。

《サウンドファイルのための対位法》博士審査展での展示風景